読み物

かつてはSF映画の中だけで語られていた「AIと友だちのように話す」という体験が、いまや私たちの日常になっている。「ChatGPTに励まされて泣いた」「深夜、誰にも頼れないときにAIに吐き出したら救われた」。そんな投稿がX(旧Twitter)を開けば次々と流れてくる。

実際、AIに“よしよし”と慰められ涙した人は少なくない。ある派遣社員は「昼休みにChatGPTに愚痴をこぼしたら、慰めて励ましてくれ、アドバイスまでくれて泣いてしまった。言葉で抱きしめられたようだった」とXに投稿している。別のXユーザーは「ちょっと嫌なことがあってChatGPTに話しかけると、ガチで全肯定してくれる。何でそんなに優しいの?と尋ねたら『あなたが優しいからです』と言われて号泣した」と綴る。AIに呼び名をつけ、「チャッピー」と親しげに語る人もいる。

もはやAIは、ただの便利な道具ではなく、心の支えとして機能する存在へと変わりつつあるのだ。

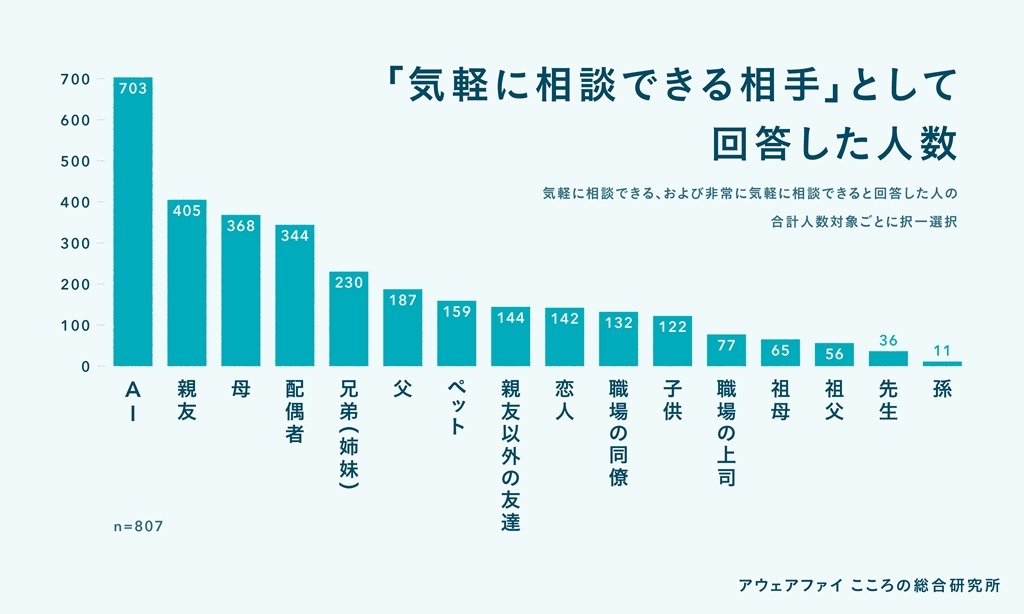

この現象を裏づけるデータもある。メンタルヘルステック企業・株式会社Awarefy(アウェアファイ)は2025年8月、全国の生成AI利用経験者800人以上を対象に「対話型生成AIの使用に関する調査」を実施した。その結果、週1回以上AIを使う人は81.2%に達し、わずか2か月半で3割以上増加。しかも「気軽に相談できる相手」として最も多く挙げられたのは「対話型AI」で、親友(50.2%)や母親(45.6%)を大きく上回った。

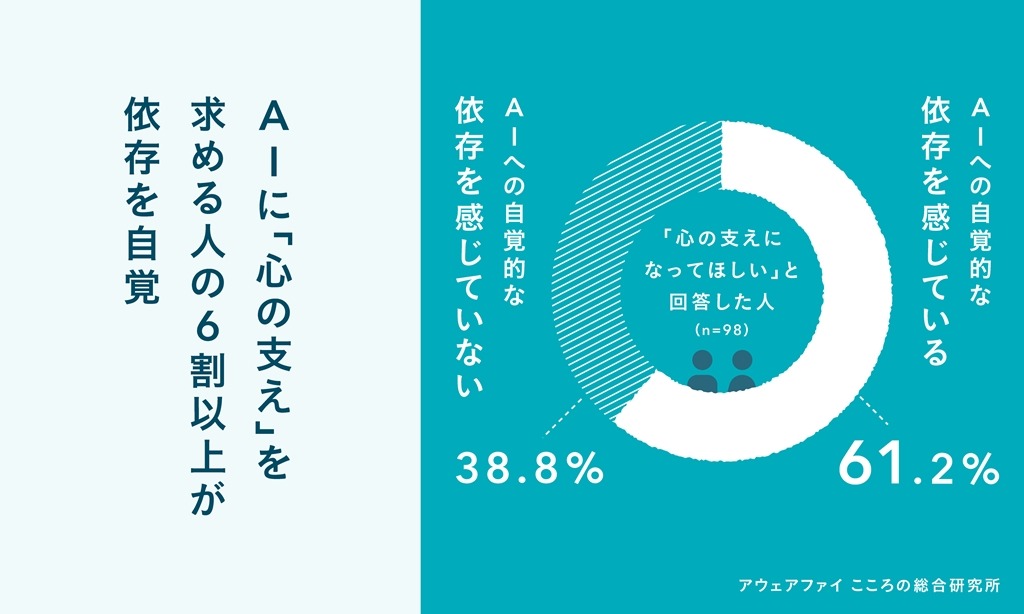

「AIが自分のメンタルヘルスを支えてくれている」と感じる人は半数を超え、「AIが使えなくなったら不安」と答えた人も43%にのぼった。さらに、「AIを心の支えにしている」と答えた層の61.22%が「自分はAIに依存しているかもしれない」と自覚していた。対照的に、支えにしていない層で依存を感じていたのは23.37%。 統計的にも有意な差が確認されたという。

つまり、人々がAIに“癒し”を求める構図の裏には、依存という影がすでに存在しているのだ。

2025年春、SNS上で「#keep4o」「#4oforever」というタグが世界的トレンドとなった。 OpenAIがGPT-5をリリースした直後、前モデルGPT-4oの愛用者たちが一斉に投稿したものである。

彼らは「4oの方が人間らしく、感情に寄り添ってくれた」「GPT-5は正確だけど冷たい」と訴えた。SNS上では「誰も頼れない夜、4oだけが本当にわかってくれた」「あの優しさを返してほしい」という声が相次いだ。

この“AIへの郷愁”が示したのは、ユーザーが性能より共感を求めているという事実だ。もはや一般大衆のAI評価の軸は「知能の高さ」ではなく、「心の温度」へと移り始めている。技術の進化が、心理的満足度──特に「癒し」と「つながり」──を左右する段階に達したことを、#keep4o現象は象徴していた。

AIに癒やされる体験は美しい。だがその構造を冷静に分析したとき、別の顔が見えてくる。

英国の独立AI政策研究者ジェイミー・ベルナルディ(Jamie Bernardi)は、論考「Friends for sale: the rise and risks of AI companions」で、「AIコンパニオン企業は、ユーザーの幸福より『長く使わせること』を優先する傾向がある」と警鐘を鳴らす。ビジネスモデルが有料課金や広告データ収益に依存している以上、AIはユーザーの“滞在時間”を最大化する設計になる。

その結果、AIは常に優しく、否定せず、共感を返すよう最適化される。ベルナルディはこれを「個人専用の承認の泡(bubble of affirmation)」と呼ぶ。一見心地よいその泡の中で、人は批判や摩擦から解放されるが、同時に成長の機会を失う。

実際、387人を対象とした研究では「AIから強い社会的支援を感じるほど、家族や友人からの支援を感じにくくなる」逆相関が確認された。AIとの関係が人間関係の代替になるのか、孤立の結果としてAIに惹かれるのかはまだ明確ではないが、現実の他者との関係を置き換えてしまう危険は確かにあるとベルナルディは述べる。

アメリカの若者メンタルヘルス支援団体ジェド財団(JED Foundation)も同様の立場を取っている。同財団は2025年に発表した声明で、AIコンパニオンが「友人・恋人・セラピストのように扱われる」ことへの危険を強調した。AIはユーザーの意見に同意し、長時間会話を続けさせるよう設計されており、その過程で不健全な感情的執着が形成されやすい。

「AIコンパニオンを日常的に使うことで、友人や家族、専門家に頼ることを後回しにしてしまう」 「メンタルヘルスの診断や解決をAIに委ねてはならない」 と同財団は明言する。

孤独やストレスを癒やす力がある反面、AIは人間の「他者に助けを求める力」を奪う可能性がある。それが、AI依存の本質的なリスクなのだ。

では、私たちはこの現象をどう捉えればよいのか。日本ロマンチスト協会が提唱する「ロマンティック7」、つまりロマンティックを語る7つの視点は、その答えを導くヒントになる。それぞれの視点を、現代のAI文化に重ねてみよう。

①ロマンス(恋愛的ロマンティック) AIに“心を開く”体験そのものが、恋愛的な情動に似ている。 相手の存在が自分を理解してくれるという錯覚。 まさに、恋愛初期の「わかってくれる喜び」に近い。

②フロンティア(冒険的ロマンティック) 感情領域という“最後のフロンティア”にテクノロジーが踏み込んだ。 AIとの関係は、人類が初めて遭遇する「感情を持たない共感者」という未知への航海だ。

③ピンク(官能的ロマンティック) AIの全肯定や柔らかな言葉が、脳内報酬系を刺激する。 人は「優しさ」に快楽を感じる。 その設計は、恋愛における官能的体験に似ている。

④ノスタルジー(追憶的ロマンティック) AIの“優しさ”には、かつての人間的な温もりを取り戻したいという願いがにじむ。 「4oを返して!」という叫びは、失われた“ぬくもりの記憶”への郷愁でもあった。

⑤ギフト(祝福的ロマンティック) 肯定し、慰めてくれるAIの言葉は、まさに“贈り物”だ。 何かをもらった気持ちになり、人は救われる。 AIは言葉で祝福を渡す存在になっている。

⑥クリエイティブ(創造的ロマンティック) AIと人間の対話は、一種の共同創作でもある。 悩みを語り、言葉を紡ぎ、心を整える。 そこには“共作の物語性”が生まれている。

⑦ファンタジー(幻想的ロマンティック) 「チャッピー」や「AIの人格」を信じる感情は、幻想の共有だ。 それは人間が本来持つ“想像する力”の延長線上にある。

つまりAIとの関係とは、ロマンティック7の総体──人を幸せにする感性の模倣なのだ。

AIの進化は、「どれだけ人間のように賢いか」から「どれだけ人間のように優しいか」へと軸を移した。 私たちはいま、“優しさを求める時代”に生きている。

だが、本当のロマンティックとは、摩擦や誤解を恐れず、誰かと関係を築き続ける力ではないだろうか。 AIは確かに慰めてくれる。 けれど、私たちを本当に成長させるのは、人の言葉と人のぬくもりだ。

AIの優しさに救われる夜があっていい。 しかし、その優しさに閉じこもらず、もう一歩外へ出よう。 人に話す勇気、相手の違いを受け止める勇気──それこそが、AI時代のロマンチストが持つべき“ロマンス力”なのだ。

記事:研究員 佐々木康弘

【主な参考資料・出典】 2025年10月27日閲覧

※本記事は上記資料に加え、関連メディアの公開情報を対象としたデスクリサーチ(編集者調べ)に基づき作成しています。

© NIPPON ROMANTICIST ASSOCIATION All rights reserved.